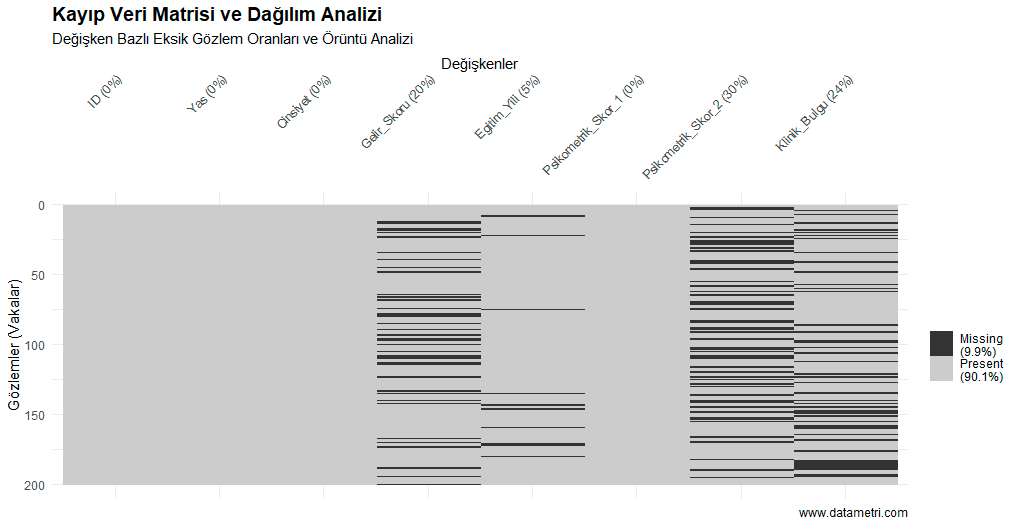

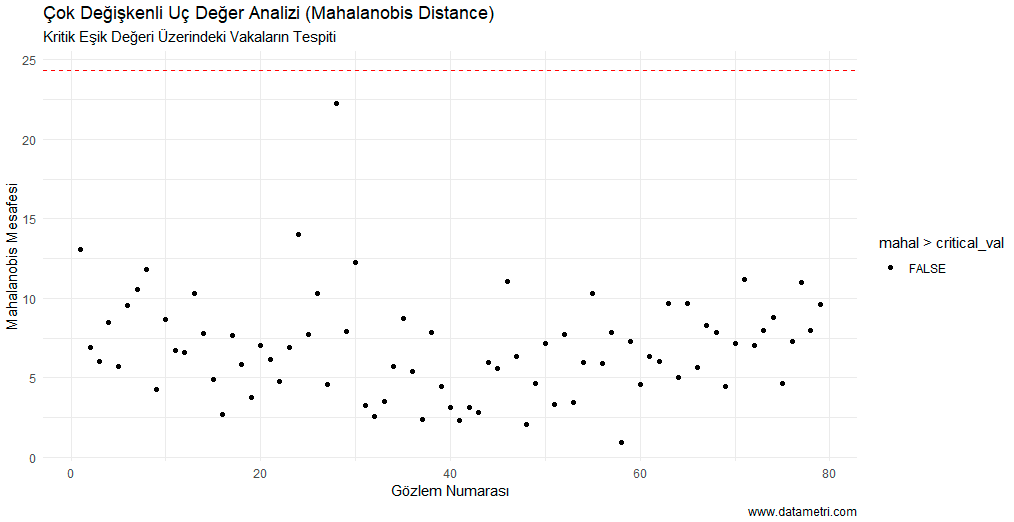

Akademik bir veri setinde eksik gözlemlerin (missing values) bulunması, sadece çalışmanın örneklem büyüklüğünü (sample size) azaltmakla kalmaz; aynı zamanda kayıp veri mekanizmasına (missing data mechanism) bağlı olarak ciddi bir yanlılık (bias) riski taşır. Verideki eksikliğin tesadüfi (random) olup olmadığının istatistiksel (örn: Little's MCAR test) tespiti, uygulanacak çoklu atama (multiple imputation) stratejisinin belirlenmesi açısından elzemdir.

- Eğer satır bazlı silme (Listwise Deletion) yoluna gidilirse, geriye kalan "tam veri" (complete-case) seti istatistiksel güç (power) analizindeki minimum n sayısını karşılıyor mu?

- Kayıp oranının kritik eşikleri aştığı değişkenler için, varyansı koruyan Çoklu Atama (Multiple Imputation) veya FIML algoritmalarından hangisi tercih edilmelidir?

- Eksik veriler belirli bir gelir grubunda veya demografik sınıfta kümelenerek (clustering) sonuçları sistematik olarak (selection bias) manipüle ediyor mu?

- Seçilim Yanlılığının (Selection Bias) Önlenmesi: Kayıp veri yönetimi, araştırmanın "temsiliyet kabiliyetini" (representativeness) korur. Uluslararası akademik yayın sürecinde hakemlerin (peer-reviewers) en sık reddetme gerekçesi olan seçilim yanlılığı eleştirisini, kayıp veri mekanizmalarını (MCAR, MAR) bilimsel olarak raporlayarak en baştan bertaraf ederiz.